27 de marzo de 2026 • Dogalyir • 5 min de lectura

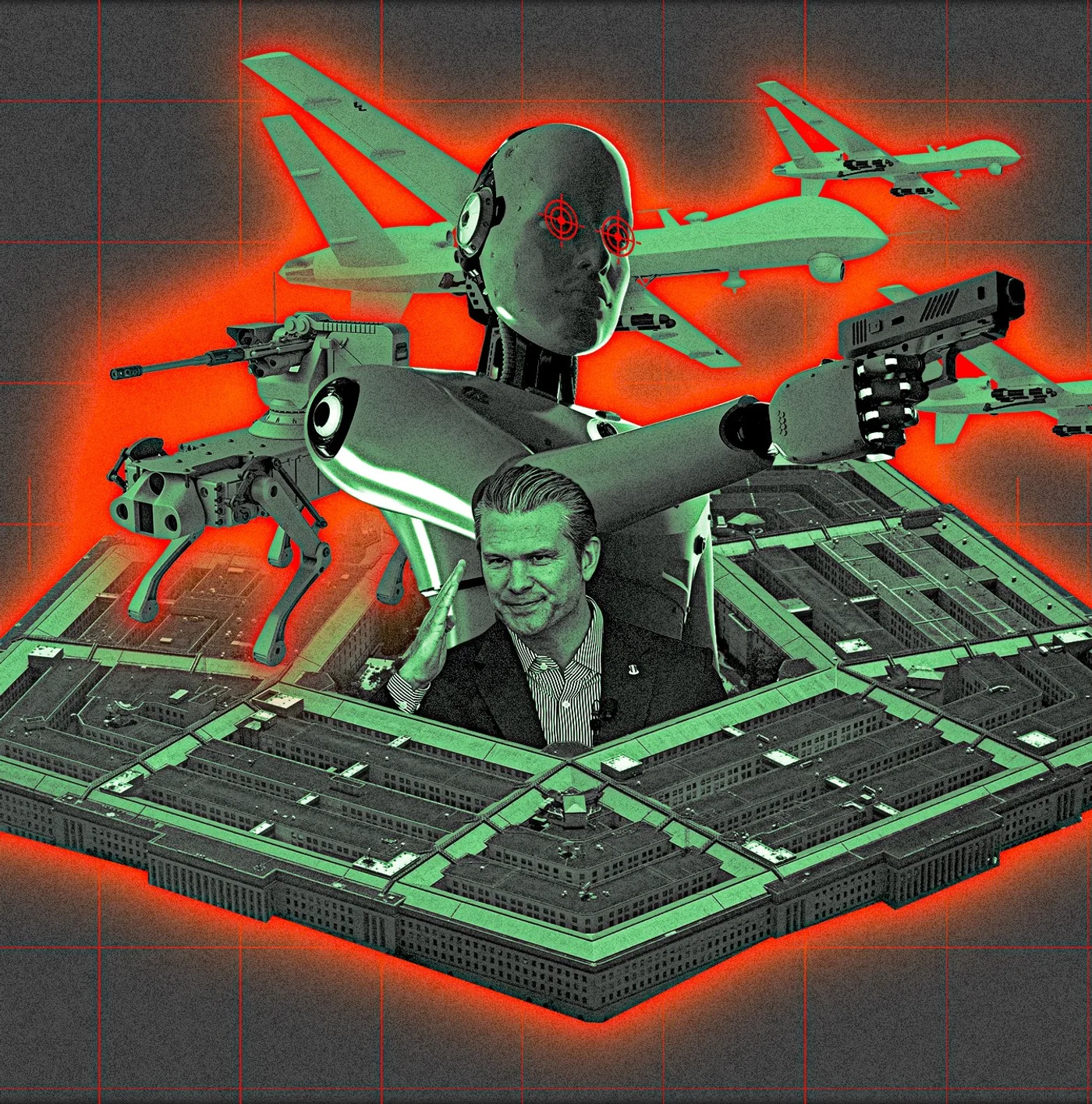

Anthropic logra suspensión temporal de veto del Pentágono en caso por libertad de expresión

En un giro significativo dentro del complejo panorama donde la tecnología de inteligencia artificial se encuentra con la política gubernamental, la compañía Anthropic ha obtenido una victoria preliminar en su enfrentamiento legal contra el Departamento de Defensa de Estados Unidos. Un juez federal ha concedido una medida cautelar que suspende temporalmente la designación de Anthropic como “riesgo en la cadena de suministro”, una decisión que había generado preocupación en el sector tecnológico por sus implicaciones para la libertad de expresión empresarial.

La jueza Rita F. Lin, del distrito norte de California, determinó en su orden que el Departamento de Defensa parece haber castigado a Anthropic por ejercer su derecho a la Primera Enmienda al expresar públicamente sus preocupaciones éticas. “Castigar a Anthropic por llevar escrutinio público a la posición contractual del gobierno es una represalia clásica e ilegal según la Primera Enmienda”, escribió la jueza en su decisión, que entrará en vigor en siete días.

El conflicto se originó cuando el Secretario de Defensa Pete Hegseth emitió un memorando el 9 de enero exigiendo que se incluyera lenguaje de “cualquier uso legal” en todos los contratos de servicios de IA dentro de 180 días. Anthropic, conocida por su modelo de lenguaje Claude, mantuvo negociaciones durante semanas con el Pentágono, estableciendo dos “líneas rojas” claras: no permitiría que su tecnología se utilizara para vigilancia masiva doméstica ni para armas autónomas letales.

Cuando las negociaciones se estancaron, el Departamento de Defensa designó a Anthropic como riesgo en la cadena de suministro, una categorización típicamente reservada para empresas extranjeras potencialmente vinculadas a adversarios de Estados Unidos. Esta designación desencadenó una cascada de consecuencias para la empresa, incluyendo confusión entre sus socios comerciales y preocupaciones sobre la continuidad de contratos existentes.

Durante la audiencia del martes, la jueza Lin destacó la naturaleza inusual del caso: “Creo que este caso toca un debate importante. Por un lado, Anthropic dice que su producto de IA, Claude, no es seguro para usar en armas letales autónomas y vigilancia masiva doméstica. Por otro lado, el Departamento de Defensa dice que los comandantes militares deben decidir qué es seguro que haga su IA”.

La jueza enfatizó que su rol no era decidir quién tenía razón en ese debate ético, sino determinar si el gobierno violó la ley al ir más allá de simplemente dejar de usar los servicios de Anthropic. “El Departamento de Defensa decide qué producto de IA quiere usar y comprar. Y todos, incluida Anthropic, están de acuerdo en que el Departamento de Defensa es libre de dejar de usar Claude y buscar un proveedor de IA más permisivo”, señaló.

Lo que hace único este caso es la designación como riesgo en la cadena de suministro y las declaraciones públicas del Secretario Hegseth, quien publicó en redes sociales que “efectivamente inmediatamente, ningún contratista, proveedor o socio que haga negocios con el ejército de Estados Unidos puede realizar ninguna actividad comercial con Anthropic”. La jueza cuestionó esta postura durante la audiencia: “Ustedes están aquí diciendo, ‘Lo dijimos pero en realidad no lo quisimos decir’”.

Las implicaciones comerciales para Anthropic son sustanciales. Según documentos judiciales presentados por la empresa, la designación ha generado confusión entre numerosos socios externos y docenas de empresas han contactado a Anthropic solicitando orientación sobre sus derechos para terminar el uso de sus servicios. La compañía alega que ingresos que suman entre cientos de millones y múltiples miles de millones de dólares podrían estar en riesgo.

En Dogalyir, comprendemos la complejidad de navegar las relaciones entre empresas tecnológicas y entidades gubernamentales. La transparencia y los principios éticos claros son fundamentales cuando se desarrollan tecnologías con potencial transformador. Este caso destaca la importancia de establecer marcos de colaboración que respeten tanto las necesidades de seguridad nacional como los valores fundamentales de las empresas innovadoras.

Durante la audiencia, la jueza Lin citó un escrito de amicus curiae que utilizaba el término “intento de asesinato corporativo”, comentando: “No sé si es ‘asesinato’, pero parece un intento de paralizar a Anthropic”. Un abogado de Anthropic argumentó que la empresa “continúa siendo irreparablemente perjudicada por esta directiva”.

El Departamento de Defensa, por su parte, ha alegado en documentos judiciales que Anthropic podría teóricamente “intentar desactivar su tecnología o alterar preventivamente el comportamiento de su modelo antes o durante operaciones de combate” si sintiera que el militar estaba cruzando sus líneas rojas, una situación que el Pentágono calificó como “riesgo inaceptable para la seguridad nacional”.

La jueza cuestionó esta afirmación en sus preguntas preparadas, solicitando evidencia concreta de que Anthropic tuviera acceso continuo o control sobre Claude después de entregarlo al gobierno para poder realizar tales actos de sabotaje.

Este caso representa un punto de inflexión en cómo las empresas de tecnología establecen límites éticos para sus creaciones y cómo los gobiernos responden a esas limitaciones. Mientras el proceso judicial continúa, con un veredicto final que podría demorar semanas o meses, la medida cautelar otorga a Anthropic un respiro temporal y establece un precedente importante sobre los derechos de las empresas tecnológicas para expresar públicamente sus principios éticos sin temor a represalias gubernamentales desproporcionadas.

Danielle Cohen, portavoz de Anthropic, declaró: “Estamos agradecidos con el tribunal por actuar con rapidez y complacidos de que coincidan en que Anthropic probablemente tendrá éxito en los méritos. Si bien este caso fue necesario para proteger a Anthropic, nuestros clientes y nuestros socios, nuestro enfoque sigue siendo trabajar productivamente con el gobierno para garantizar que todos los estadounidenses se beneficien de una IA segura y confiable”.

La resolución final de este caso podría tener implicaciones de largo alcance para la industria de la inteligencia artificial, estableciendo límites claros sobre hasta qué punto el gobierno puede penalizar a empresas por establecer restricciones éticas en el uso de sus tecnologías. En un mundo donde la IA se integra cada vez más en sistemas críticos, este equilibrio entre innovación responsable, libertad empresarial y seguridad nacional seguirá siendo un tema de debate crucial.”