8 de abril de 2026 • Dogalyir • 11 min de lectura

Identificando los momentos clave de transparencia en IA agentica (Parte 1)

Identificando los momentos clave de transparencia en IA agentica (Parte 1)

Diseñar para agentes de inteligencia artificial autónomos presenta un desafío único: entregamos una tarea compleja al sistema, este desaparece durante segundos o minutos, y luego regresa con un resultado. En ese momento, los usuarios se enfrentan a la incertidumbre: ¿funcionó correctamente? ¿Cometió algún error? ¿Siguió todos los pasos necesarios? Esta ansiedad suele llevar a dos extremos poco efectivos.

Por un lado, mantenemos el sistema como una caja negra, ocultando todos los procesos internos para preservar la simplicidad. Por otro, caemos en el volcado de datos, mostrando cada línea de registro y llamada API al usuario. Ninguno de estos enfoques aborda la sutileza necesaria para ofrecer el nivel ideal de transparencia. La caja negra deja a los usuarios sintiéndose impotentes, mientras que el volcado de datos genera fatiga de notificaciones, destruyendo la eficiencia que el agente prometía proporcionar.

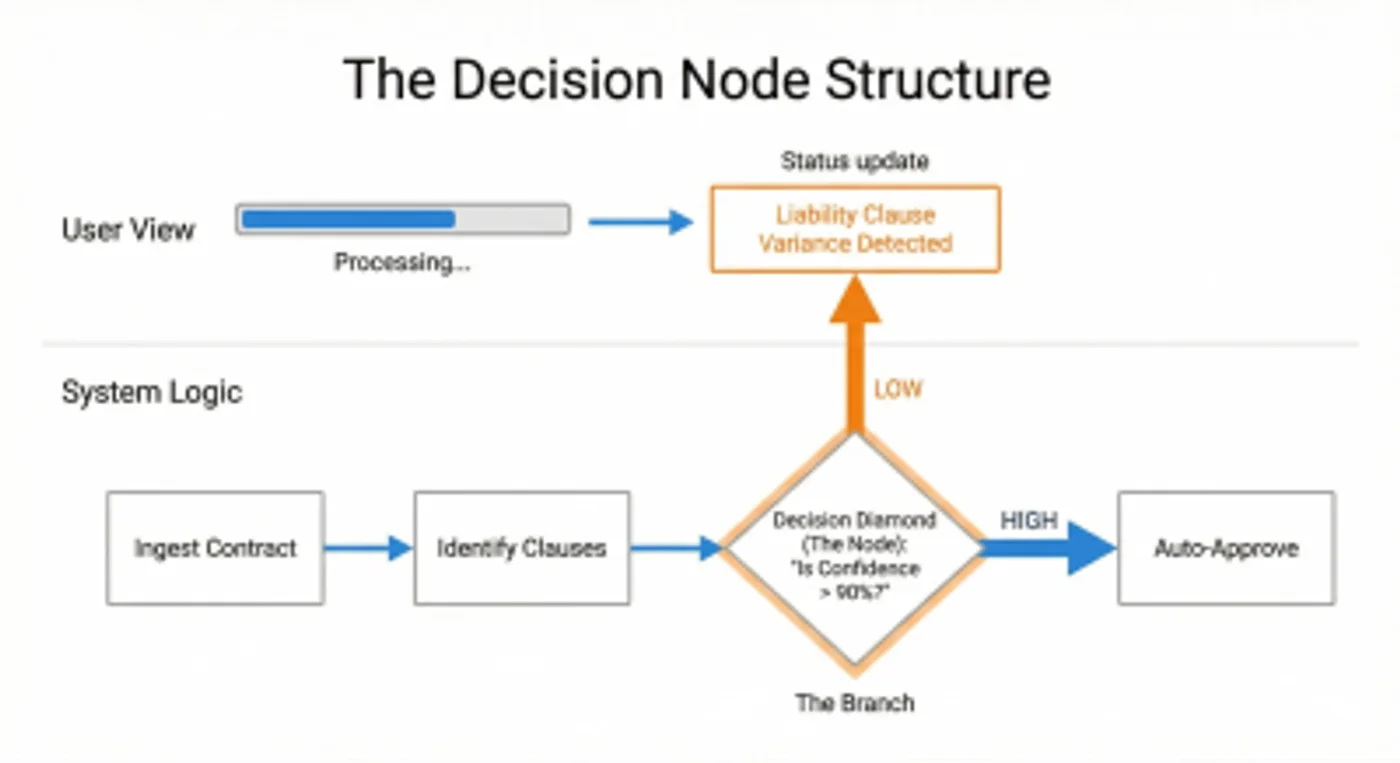

En Dogalyir, entendemos que la clave está en encontrar un equilibrio organizado. En lugar de preguntarnos primero “¿cómo debe verse la interfaz?”, debemos comenzar con “¿qué está decidiendo realmente el agente?”. Este artículo presenta un método práctico para responder esa pregunta: la Auditoría de Nodos de Decisión, un proceso que reúne a diseñadores e ingenieros para mapear la lógica del backend con la experiencia del usuario.

Un caso de estudio: Meridian y la transparencia en seguros

Consideremos el ejemplo de Meridian (nombre ficticio), una compañía de seguros que utiliza una IA agentica para procesar reclamos iniciales de accidentes. Los usuarios suben fotos de daños vehiculares y el informe policial. El agente desaparece por un minuto antes de devolver una evaluación de riesgo y un rango de pago propuesto.

Inicialmente, la interfaz solo mostraba “Calculando estado del reclamo”. Los usuarios se frustraban, inseguros de si la IA había revisado el informe policial, que contenía circunstancias atenuantes. Para solucionarlo, el equipo de diseño realizó una Auditoría de Nodos de Decisión, identificando tres pasos distintos basados en probabilidades:

- Análisis de imágenes: Comparar las fotos de daños contra una base de datos de escenarios típicos de accidentes para estimar el costo de reparación.

- Revisión textual: Escanear el informe policial en busca de palabras clave que afecten la responsabilidad (por ejemplo, culpa, condiciones climáticas, sobriedad).

- Referencia cruzada de pólizas: Emparejar los detalles del reclamo con los términos específicos de la póliza del usuario, buscando excepciones o límites de cobertura.

El equipo transformó estos pasos en momentos de transparencia, actualizando la secuencia de la interfaz para mostrar mensajes específicos como “Evaluando fotos de daños: Comparando contra 500 perfiles de impacto vehicular”. Aunque el sistema tomaba el mismo tiempo, la comunicación explícita restauró la confianza de los usuarios, transformando un momento de ansiedad en una conexión significativa.

La matriz de impacto/riesgo: Decidiendo qué ocultar

La mayoría de las experiencias de IA generan numerosos eventos y nodos de decisión que podrían mostrarse. Un resultado crítico de la auditoría es decidir qué mantener invisible. En el ejemplo de Meridian, los registros del backend generaban más de 50 eventos por reclamo. En lugar de mostrarlos todos, aplicamos una matriz de impacto/riesgo para priorizar:

- Evento de bajo riesgo y alta tecnicidad: Por ejemplo, “Haciendo ping al servidor West-2 para verificación de redundancia”. Decisión: Ocultar.

- Evento de alto riesgo e impacto: Como “Comparando estimación de reparación con el valor BlueBook”. Decisión: Mostrar, ya que afecta directamente el pago del usuario.

Al eliminar detalles innecesarios, la información importante se vuelve más impactante. Este enfoque se basa en la idea de que las personas se sienten mejor con un servicio cuando pueden ver el trabajo que se está realizando. Mostrar pasos específicos convierte una espera de 30 segundos de preocupación (“¿Está roto?”) en una sensación de valor (“Está pensando”).

La Auditoría de Nodos de Decisión: Un proceso paso a paso

La transparencia falla cuando la tratamos como una elección de estilo en lugar de un requisito funcional. La Auditoría de Nodos de Decisión es una forma sencilla de hacer que los sistemas de IA sean más comprensibles, mapeando los procesos internos para identificar momentos donde el sistema deja de seguir reglas fijas y toma decisiones basadas en probabilidades. Aquí te presentamos un checklist práctico:

Fase 1: Configuración y mapeo

- Reúne al equipo: Involucra a dueños de producto, analistas de negocio, diseñadores, tomadores de decisiones clave y los ingenieros que construyeron la IA. Necesitas que los ingenieros expliquen la lógica del backend; no intentes este paso solo.

- Dibuja todo el proceso: Documenta cada paso que toma la IA, desde la primera acción del usuario hasta el resultado final. Una sesión en pizarra física suele funcionar mejor para visualizar estos pasos iniciales.

Fase 2: Localizando la lógica oculta

- Encuentra dónde las cosas son poco claras: Busca en el mapa de procesos cualquier punto donde la IA compare opciones o entradas que no tienen una coincidencia perfecta.

- Identifica los pasos de “mejor suposición”: Para cada punto poco claro, verifica si el sistema utiliza una puntuación de confianza (por ejemplo, ¿está 85% seguro?). Estos son los momentos donde la IA toma una elección final.

- Examina la elección: Para cada punto de decisión, determina la matemática interna específica o la comparación que se realiza, como emparejar una parte de un contrato con una póliza o comparar una foto de un auto dañado con una biblioteca de imágenes.

Fase 3: Creando la experiencia del usuario

- Escribe explicaciones claras: Crea mensajes para el usuario que describan claramente la acción interna específica que ocurre cuando la IA toma una decisión. Fundamenta tus mensajes en la realidad concreta; por ejemplo, si una IA reserva una reunión en una cafetería, dile al usuario que el sistema está verificando la disponibilidad en el sistema de reservas.

- Actualiza la pantalla: Incorpora estas nuevas explicaciones en la interfaz de usuario, reemplazando mensajes vagos como “Revisando contratos” con descripciones específicas.

- Verifica la confianza: Asegúrate de que los nuevos mensajes en pantalla den a los usuarios una razón simple para cualquier tiempo de espera o resultado, lo que debería hacerlos sentirse confiados. Prueba estos mensajes con usuarios reales para confirmar que comprenden el resultado específico que se está logrando.

Mapeando nodos a patrones: Una rúbrica de selección de diseño

Una vez identificados los nodos de decisión clave, debes decidir qué patrón de interfaz aplicar a cada uno que mostrarás. En Dogalyir, utilizamos factores como la reversibilidad para guiar esta elección:

- Alto riesgo e irreversible: Estos nodos requieren una Vista Previa de Intención. Dado que el usuario no puede deshacer fácilmente la acción (por ejemplo, eliminar permanentemente una base de datos), el momento de transparencia debe ocurrir antes de la ejecución. El sistema debe pausar, explicar su intención y requerir confirmación.

- Alto riesgo y reversible: Estos nodos pueden confiar en el patrón de Auditoría de Acción y Deshacer. Si un agente de ventas impulsado por IA mueve un lead a un pipeline diferente, puede hacerlo de forma autónoma siempre que notifique al usuario y ofrezca un botón de Deshacer inmediato.

Al categorizar estrictamente los nodos de esta manera, evitamos la “fatiga de alertas”, reservando la Vista Previa de Intención solo para momentos verdaderamente irreversibles, mientras mantenemos la velocidad con la Auditoría de Acción para todo lo demás.

Validación cualitativa: La prueba “Espera, ¿por qué?”

Puedes identificar nodos potenciales en una pizarra, pero debes validarlos con el comportamiento humano. Utiliza un protocolo llamado prueba “Espera, ¿por qué?”: pide a un usuario que observe al agente completar una tarea y hable en voz alta. Cada vez que pregunte “¿Espera, por qué hizo eso?” o “¿Está atascado?”, marca un timestamp. Estas preguntas señalan confusión del usuario y revelan momentos faltantes de transparencia.

Por ejemplo, en un estudio para un asistente de programación de citas médicas, los usuarios veían al agente reservar una cita. La pantalla permanecía estática durante cuatro segundos, y los participantes consistentemente preguntaban “¿Está revisando mi calendario o el del doctor?”. Esta pregunta reveló un Momento de Transparencia faltante, llevando al sistema a dividir esa espera en dos pasos distintos: “Verificando tu disponibilidad” seguido de “Sincronizando con el horario del proveedor”. Este pequeño cambio redujo los niveles de ansiedad expresados por los usuarios.

La transparencia falla cuando solo describe una acción del sistema; la interfaz debe conectar el proceso técnico con el objetivo específico del usuario. En Dogalyir, enfatizamos la importancia de emparejar la acción con el resultado, fundamentando el proceso técnico en la vida real del usuario para construir confianza de manera efectiva.

Operacionalizando la auditoría: Trabajo en equipo para la transparencia

Una vez completada la Auditoría de Nodos de Decisión y filtrada la lista a través de la Matriz de Impacto y Riesgo, tienes una lista de momentos esenciales para ser transparente. Crearlos en la interfaz requiere trabajo en equipo entre departamentos. No puedes diseñar la transparencia solo con una herramienta de diseño; necesitas entender cómo funciona el sistema detrás de escena.

Comienza con una Revisión de Lógica: reúnete con tu diseñador principal del sistema y lleva tu mapa de nodos de decisión. Necesitas confirmar que el sistema puede realmente compartir estos estados. A menudo, el sistema técnico no revela el estado exacto que quieres mostrar, por lo que debes abogar por actualizaciones detalladas. Sin esa conexión técnica, tu diseño es imposible de construir.

Luego, involucra al equipo de Diseño de Contenido. Tienes la razón técnica para la acción de la IA, pero necesitas una explicación clara y amigable para los humanos. Los ingenieros proporcionan el proceso subyacente, pero los diseñadores de contenido proporcionan la forma en que se comunica. No escribas estos mensajes solo; un desarrollador podría escribir “Ejecutando función 402” (técnicamente correcto pero sin significado para el usuario), mientras que un diseñador podría escribir “Pensando” (amigable pero demasiado vago). Un estratega de contenido encuentra el punto medio adecuado, creando frases específicas como “Escaneando en busca de riesgos de responsabilidad” que muestran que la IA está trabajando sin confundir al usuario.

Finalmente, prueba la transparencia de tus mensajes. No esperes hasta que el producto final esté construido para ver si el texto funciona. Realiza pruebas de comparación en prototipos simples donde lo único que cambia es el mensaje de estado. Por ejemplo, muestra a un grupo un mensaje que dice “Verificando identidad” y a otro grupo “Consultando bases de datos gubernamentales” (ejemplos ficticios), luego pregunta cuál IA se siente más segura. Descubrirás que ciertas palabras causan preocupación, mientras que otras construyen confianza. Debes tratar la redacción como algo que necesitas probar y demostrar efectivo.

Cómo esto cambia el proceso de diseño

Realizar estas auditorías tiene el potencial de fortalecer cómo trabaja un equipo conjunto. Dejamos de entregar archivos de diseño pulidos y comenzamos a usar prototipos desordenados y hojas de cálculo compartidas. La herramienta central se convierte en una matriz de transparencia, donde ingenieros y diseñadores de contenido editan juntos, mapeando códigos técnicos exactos a las palabras que leerá el usuario.

Los equipos experimentarán fricción durante la revisión de lógica. Imagina a un diseñador preguntando a un ingeniero cómo la IA decide rechazar una transacción en un informe de gastos. El ingeniero podría decir que el backend solo emite un código de estado genérico como “Error: Datos faltantes”. El diseñador señala que esta información no es accionable en pantalla y negocia con el ingeniero para crear un gancho técnico específico, como que el sistema informe exactamente qué falta, por ejemplo, una imagen de recibo.

Los diseñadores de contenido actúan como traductores durante esta fase, reescribiendo cadenas técnicamente precisas en frases que construyan confianza para un resultado específico. Todo el equipo funcional cruzado se sienta en sesiones de prueba de usuarios, observando a una persona real reaccionar a diferentes mensajes de estado. Ver a un usuario entrar en pánico porque la pantalla dice “Ejecutando operación” obliga al equipo a repensar su enfoque, alineándose en una mejor redacción, como “Verificando fondos suficientes” antes de comprar acciones. Probar juntos garantiza que la interfaz final sirva tanto a la lógica del sistema como a la tranquilidad del usuario.

Requiere tiempo incorporar estas actividades adicionales al calendario del equipo, pero el resultado final debería ser un equipo que se comunica más abiertamente y usuarios que comprenden mejor lo que sus herramientas impulsadas por IA están haciendo en su nombre (y por qué). Este enfoque integrado es una piedra angular para diseñar experiencias de IA verdaderamente confiables.

La confianza no es solo un subproducto emocional de una buena experiencia de usuario; es un resultado mecánico de la comunicación predecible. La construimos mostrando la información correcta en el momento adecuado, y la destruimos abrumando al usuario u ocultando la maquinaria por completo. Comienza con la Auditoría de Nodos de Decisión, especialmente para herramientas y productos de IA agentica. Encuentra los momentos donde el sistema toma una decisión basada en juicio, mapea esos momentos a la Matriz de Riesgo, y si las apuestas son altas, abre la caja y muestra el trabajo. En Dogalyir, creemos que este método no solo mejora la usabilidad, sino que también establece una base sólida para la adopción responsable de tecnologías avanzadas.