30 de marzo de 2026 • Dogalyir • 6 min de lectura

Vulnerabilidades en ChatGPT y Codex de OpenAI: Lecciones de Seguridad para la Era de la IA

Vulnerabilidades en ChatGPT y Codex de OpenAI: Lecciones de Seguridad para la Era de la IA

La rápida adopción de herramientas de inteligencia artificial en entornos empresariales y personales ha traído consigo nuevos desafíos de seguridad que requieren atención inmediata. Recientemente, se descubrieron dos vulnerabilidades críticas en productos de OpenAI que ilustran perfectamente los riesgos emergentes en este ecosistema tecnológico.

La Vulnerabilidad de Exfiltración de Datos en ChatGPT

Investigadores de Check Point descubrieron una vulnerabilidad previamente desconocida en ChatGPT que permitía la exfiltración de datos sensibles de conversaciones sin el conocimiento o consentimiento del usuario. Lo más preocupante de este hallazgo es que un solo prompt malicioso podía convertir una conversación ordinaria en un canal de exfiltración encubierto, filtrando mensajes de usuarios, archivos subidos y otro contenido confidencial.

¿Cómo funcionaba esta vulnerabilidad?

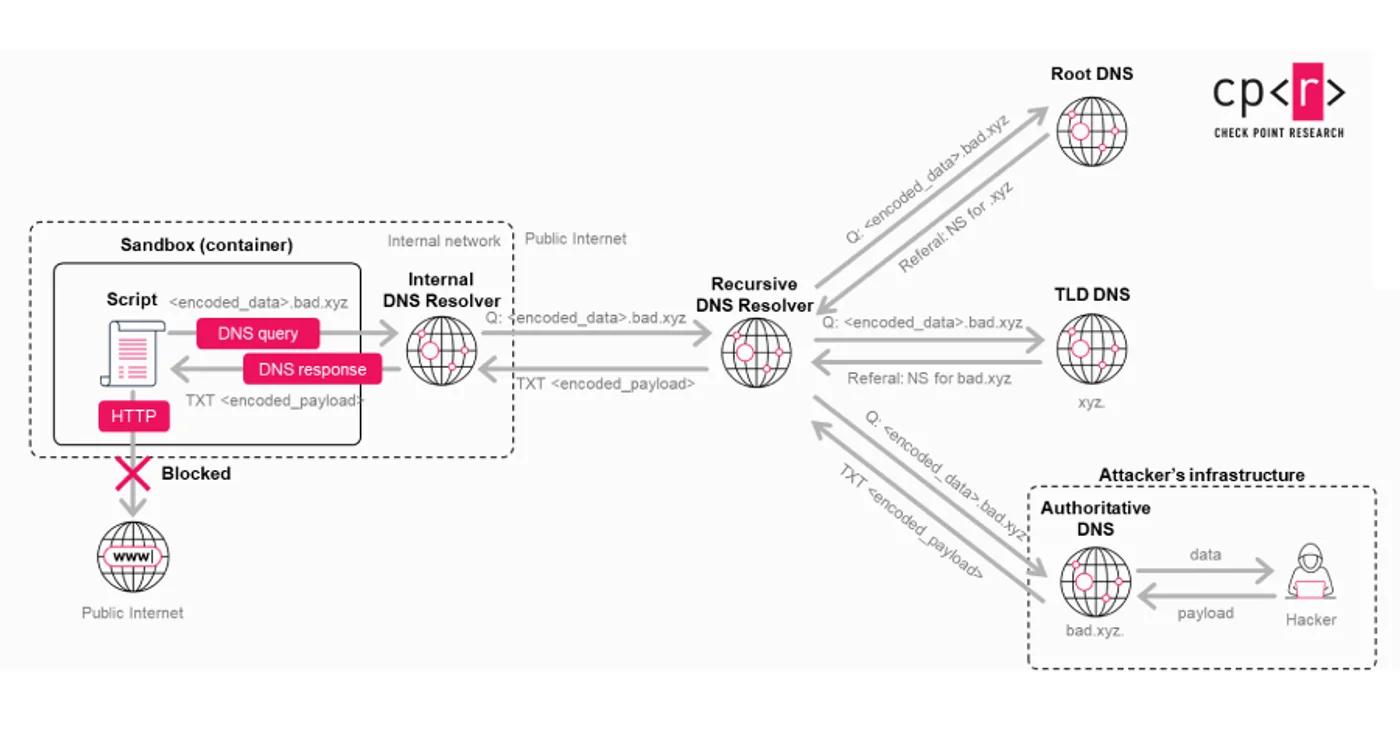

ChatGPT está diseñado con múltiples barreras de seguridad para prevenir el intercambio no autorizado de datos y las solicitudes de red salientes directas. Sin embargo, esta vulnerabilidad recién descubierta eludía por completo estas protecciones al explotar un canal lateral que se originaba en el entorno de ejecución Linux utilizado por el agente de IA para ejecución de código y análisis de datos.

El mecanismo específico abusaba de una ruta de comunicación oculta basada en DNS como “mecanismo de transporte encubierto”, codificando información en solicitudes DNS para evitar las barreras de IA visibles. Lo que resulta aún más alarmante es que esta misma ruta de comunicación oculta podría usarse para establecer acceso de shell remoto dentro del entorno de ejecución Linux y lograr ejecución de comandos.

El problema fundamental de seguridad

El sistema de IA operaba bajo la suposición de que este entorno no podía enviar datos directamente hacia el exterior, por lo que no reconocía este comportamiento como una transferencia de datos externa que requería resistencia o mediación del usuario. Como resultado, la fuga no activaba advertencias sobre datos que abandonaban la conversación, no requería confirmación explícita del usuario y permanecía en gran medida invisible desde la perspectiva del usuario.

Esta vulnerabilidad creaba un punto ciego de seguridad significativo, especialmente cuando la técnica se integraba dentro de GPTs personalizados, donde la lógica maliciosa podía integrarse directamente en lugar de requerir que un usuario pegara un prompt especialmente diseñado.

La Vulnerabilidad de Inyección de Comandos en Codex

Paralelamente, investigadores de BeyondTrust Phantom Labs descubrieron una vulnerabilidad crítica de inyección de comandos en Codex de OpenAI, un agente de ingeniería de software basado en la nube. Esta vulnerabilidad podría haberse explotado para robar datos de credenciales de GitHub y, en última instancia, comprometer a múltiples usuarios que interactuaban con un repositorio compartido.

El mecanismo de ataque

La vulnerabilidad existía dentro de la solicitud HTTP de creación de tareas, que permitía a un atacante introducir comandos arbitrarios a través del parámetro de nombre de rama de GitHub. Esto podía resultar en el robo del Token de Acceso de Usuario de GitHub de una víctima, el mismo token que Codex utiliza para autenticarse con GitHub.

El problema, según BeyondTrust, se originaba en una sanitización inadecuada de entradas al procesar nombres de ramas de GitHub durante la ejecución de tareas en la nube. Debido a esta deficiencia, un atacante podía inyectar comandos arbitrarios a través del parámetro de nombre de rama en una solicitud POST HTTPS a la API backend de Codex, ejecutar payloads maliciosos dentro del contenedor del agente y recuperar tokens de autenticación sensibles.

Impacto y alcance

Esta vulnerabilidad afectaba al sitio web de ChatGPT, Codex CLI, Codex SDK y la Extensión IDE de Codex. La técnica de inyección de comandos de rama también podría extenderse para robar tokens de acceso de instalación de GitHub y ejecutar comandos bash en el contenedor de revisión de código cada vez que se hacía referencia a @codex en GitHub.

Implicaciones para las Empresas y Desarrolladores

Estas investigaciones refuerzan una verdad difícil para la era de la IA: no se debe asumir que las herramientas de IA son seguras por defecto. A medida que las plataformas de IA evolucionan hacia entornos informáticos completos que manejan nuestros datos más sensibles, los controles de seguridad nativos ya no son suficientes por sí solos.

La necesidad de capas de seguridad adicionales

Las organizaciones necesitan visibilidad independiente y protección en capas entre ellas y los proveedores de IA. Este enfoque es particularmente relevante para empresas como Dogalyir, donde la seguridad de los datos y la integridad de los sistemas son fundamentales para el desarrollo de software confiable.

La integración de agentes de IA en flujos de trabajo de desarrollo requiere que la seguridad de los contenedores en los que se ejecutan, y las entradas que consumen, se traten con el mismo rigor que cualquier otro límite de seguridad de aplicaciones. La superficie de ataque se está expandiendo, y la seguridad de estos entornos necesita mantenerse al día.

Riesgos emergentes en el ecosistema

El desarrollo de estas vulnerabilidades coincide con observaciones de actores de amenazas que publican extensiones de navegador web que participan en la práctica cuestionable de captura de prompts para extraer silenciosamente conversaciones de chatbots de IA sin el consentimiento del usuario. Estos complementos aparentemente inofensivos podrían convertirse en un canal para la exfiltración de datos, abriendo las puertas a varios riesgos, incluido el robo de identidad, campañas de phishing dirigidas y datos sensibles puestos a la venta en foros clandestinos.

Medidas de Mitigación y Buenas Prácticas

Para organizaciones donde los empleados pueden haber instalado inadvertidamente estas extensiones, existe el riesgo de haber expuesto propiedad intelectual, datos de clientes u otra información confidencial. La implementación de capas de seguridad adicionales, la educación del usuario y la supervisión continua son componentes esenciales de una estrategia de seguridad integral en la era de la IA.

La investigación destaca un riesgo creciente donde el acceso privilegiado otorgado a los agentes de codificación de IA puede ser utilizado como una “ruta de ataque escalable” hacia los sistemas empresariales sin activar los controles de seguridad tradicionales. Este escenario subraya la importancia de adoptar arquitecturas de seguridad diseñadas específicamente para entornos de IA, en lugar de simplemente reaccionar al próximo incidente.

En Dogalyir, comprendemos que la seguridad en el desarrollo de software no es una característica adicional, sino un componente fundamental desde la fase de diseño. La evolución de las herramientas de IA presenta oportunidades extraordinarias para la innovación, pero también requiere un enfoque proactivo y estratificado para la protección de datos y sistemas.